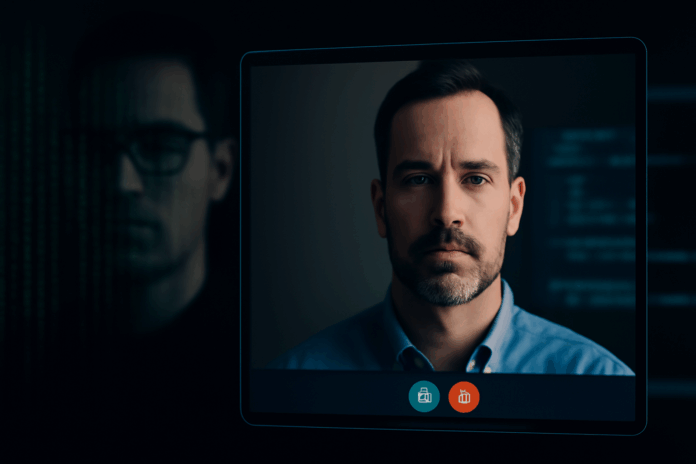

Rostos perfeitamente esculpidos, vozes idênticas às originais e interações aparentemente autênticas. Com a ascensão dos deepfakes e golpes baseados em inteligência artificial, empresas e profissionais de tecnologia enfrentam um desafio urgente: como saber se estão falando com alguém real? Em meio a uma avalanche de fraudes que usam IA para enganar até os mais céticos, o que antes era um cuidado razoável virou rotina paranoica.

O cenário atual força executivos de TI, recrutadores e líderes de áreas críticas a adotarem táticas de verificação dignas de operações de contrainteligência — exigindo vídeos com câmeras ligadas, códigos de verificação pessoais, selfies com data e hora e até testes de linguagem nativa para confirmar identidade.

A motivação? Golpes que vão muito além dos e-mails mal escritos ou propostas suspeitas. Estamos diante de criminosos que criam personas realistas, imitam profissionais conhecidos e usam tecnologias de vídeo e áudio em tempo real para fraudar processos seletivos, entrevistas de negócios e parcerias estratégicas.

Golpes de emprego e fraudes em entrevistas: o caso Nicole Yelland

Nicole Yelland, executiva de comunicação nos Estados Unidos, viveu isso na pele. Ao aceitar uma proposta de entrevista para uma vaga de alto nível, foi envolvida em um golpe extremamente convincente. A “empresa” era legítima — ou parecia ser. O contato compartilhava material de onboarding, políticas internas e até um organograma. Mas tudo desmoronou quando, durante uma videochamada, os recrutadores se recusaram a ativar as câmeras e passaram a exigir documentos pessoais sensíveis, como carteira de motorista. A farsa só ficou clara quando o tom da abordagem passou a violar limites básicos de segurança.

Deepfake ao vivo: a ameaça que se movimenta e responde

Diferente de fraudes passadas, os deepfakes modernos já não se limitam a vídeos falsos estáticos. Estão migrando para interações em tempo real, onde golpistas se passam por pessoas reais — com rostos, vozes e maneirismos quase indistinguíveis. Plataformas como o LinkedIn têm se tornado um terreno fértil para esses enganos, especialmente com o uso de fotos geradas por IA que simulam profissionais com perfeição plástica, mas sem histórico verificável.

Segurança analógica em um mundo digital

Diante da ineficiência das soluções digitais tradicionais, muitos profissionais estão recorrendo a métodos quase “analógicos” de verificação: pedir que a pessoa vire a câmera do celular para o computador, solicitar detalhes locais (como cafés e ruas da cidade onde dizem viver), ou enviar mensagens cruzadas entre plataformas para verificar se o contato é genuíno.

Ken Schumacher, fundador de uma startup de verificação de recrutamento, conta que empresas têm utilizado “truques de ambientação”, como pedir referências visuais ou dados do cotidiano, para verificar se o interlocutor está mesmo em determinada região. Outros profissionais compartilham “palavras-chave secretas” com colegas, a fim de confirmar a autenticidade em caso de dúvidas.

Startups tentam combater IA com IA

Frente a esse cenário, empresas como Reality Defender e GetReal Labs surgiram para tentar combater o fogo com fogo: IA contra IA. Elas desenvolvem tecnologias capazes de identificar padrões e inconsistências típicas de deepfakes, tanto em vídeos quanto em imagens. A OpenAI, por sua vez, aposta na biometria. Sam Altman, CEO da empresa, lidera também a Tools for Humanity, que desenvolve scanners oculares capazes de criar um “ID digital humano” registrado em blockchain — uma tentativa de “provar” que uma pessoa é de fato real.

No entanto, essas soluções ainda estão longe de se tornar padrão corporativo e, para muitos executivos, ainda geram preocupações com privacidade e viabilidade operacional.

O impacto para a liderança de TI

Para CIOs, CISOs e líderes de segurança digital, o crescimento dessas ameaças significa a necessidade de revisar protocolos de onboarding, processos de entrevista, parcerias e até interações internas. O impacto vai além do risco imediato de um golpe financeiro — envolve o desgaste na confiança, o aumento de falsos positivos em interações legítimas e a perda de agilidade em processos de contratação e tomada de decisão.

Jessica Eise, pesquisadora da Universidade de Indiana, relata que sua equipe acadêmica foi forçada a se especializar em perícia digital apenas para garantir que participantes de pesquisas remuneradas fossem reais. Com métodos como análise de fuso horário de e-mails e padrões de respostas, eles eliminaram fraudes — mas à custa de tempo e recursos.

A paranoia virou parte do protocolo

No fim, a “era da paranoia” parece ter chegado para ficar. Profissionais e empresas precisam se adaptar, equilibrando cautela e agilidade, confiando menos nas aparências e mais em processos objetivos de verificação. A linha entre prudência e desconfiança está mais tênue do que nunca.

Siga o Itshow no LinkedIn e assine a nossa News para ficar por dentro de todas as notícias do setor de TI e Telecom!